AI 기초 서론 2/3

AI를 처음 접할 때 가장 먼저 부딪히는 장벽은 복잡한 기술이 아니라 바로 낯선 ‘용어’입니다. 따라서 본격적인 학습에 앞서 명확한 AI 용어정리가 반드시 필요합니다. 머신러닝, 딥러닝, LLM, 생성형 AI… 듣다 보면 전부 비슷한 AI 같아서 결국 다 똑같은 말처럼 느껴지기 쉽죠.

하지만 이 용어들의 차이를 한 번만 확실하게 짚고 넘어가면, 이후에 쏟아지는 IT 뉴스들이 훨씬 수월하게 읽히고 챗봇이나 이미지 생성 도구를 사용할 때도 기술에 덜 휘둘리게 됩니다.

이번 글의 목표는 복잡한 수식이나 기술적 원리를 파고드는 것이 아닙니다. 그보다는 확실한 AI 용어정리를 통해 “이 용어들이 서로 어떤 관계에 있는지” 한눈에 들어오는 뼈대를 잡아드리는 것입니다. 이 큰 그림만 잘 그려두면, 나중에 머신러닝이나 LLM을 더 깊게 공부할 때도 길을 잃지 않을 수 있습니다.다.

💡 추천: 이 시리즈의 1부인 AI 리터러시: AI 시대의 기본 문해력과 필수 생존 역량을 먼저 읽어보시면, 왜 지금 이 개념 지도가 꼭 필요한지 그 맥락을 훨씬 자연스럽게 연결하실 수 있습니다.

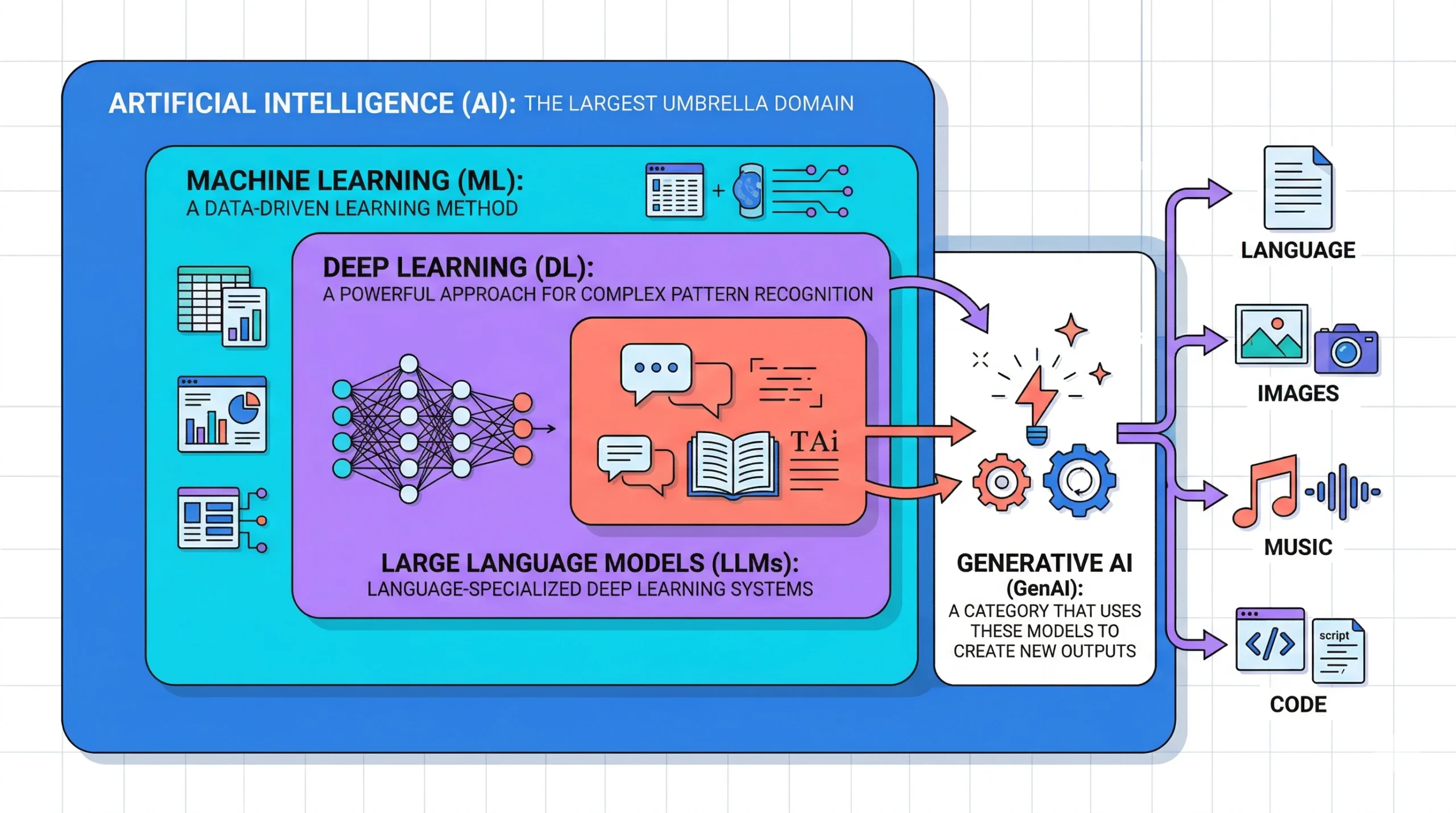

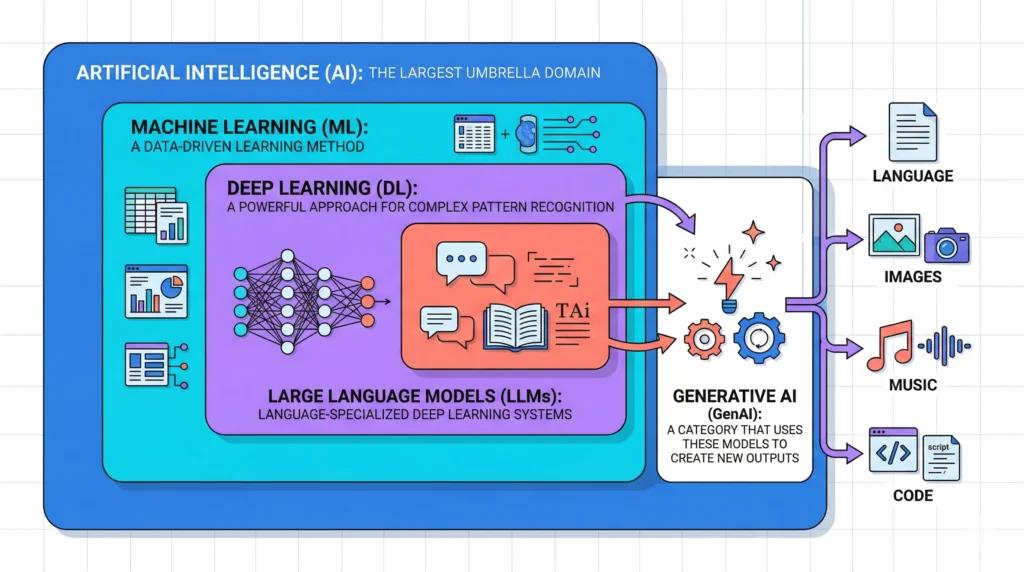

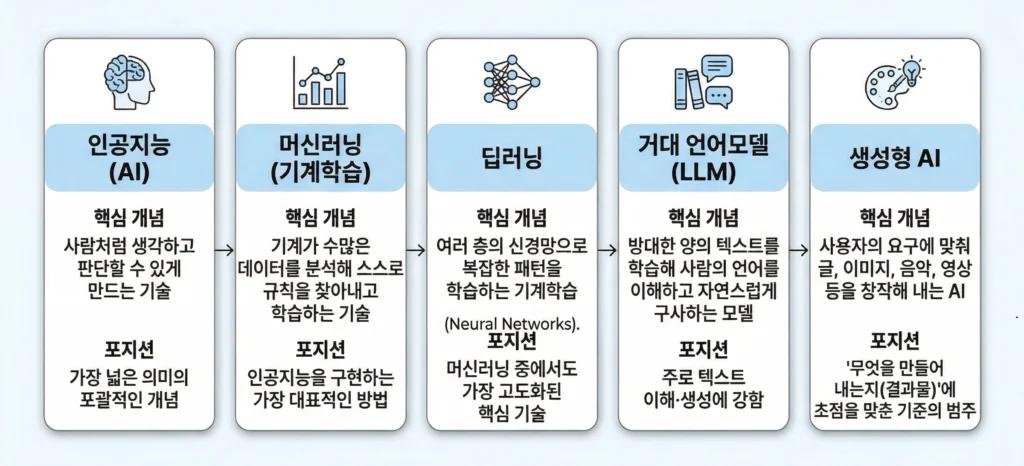

한장으로 보는 ‘AI 용어정리’

| 용어 | 핵심 개념 | 포지션 |

|---|---|---|

| 인공지능(AI) | 사람처럼 생각하고 판단할 수 있게 만드는 기술 | 가장 넓은 의미의 포괄적인 개념 |

| 머신러닝(기계학습) | 기계가 수많은 데이터를 분석해 스스로 규칙을 찾아내고 학습하는 기술 | 인공지능을 구현하는 가장 대표적인 방법 |

| 딥러닝 | 여러 층의 신경망으로 복잡한 패턴을 학습하는 기계학습 | 머신러닝 중에서도 가장 고도화된 핵심 기술 |

| 거대 언어모델(LLM) | 방대한 양의 텍스트를 학습해 사람의 언어를 이해하고 자연스럽게 구사하는 모델 | 주로 텍스트 이해·생성에 강함 |

| 생성형 AI | 사용자의 요구에 맞춰 글, 이미지, 음악, 영상 등을 창작해 내는 AI | ‘무엇을 만들어 내는지(결과물)’에 초점을 맞춘 기준의 범주 |

여기서 꼭 짚고 넘어가야 할 핵심이 있습니다. 머신러닝과 딥러닝, LLM이 기술이 어떻게 발전해 왔는지 그 ‘뿌리’를 설명한다면, 생성형 AI는 ‘무엇을 만들어 내는지’에 초점을 맞춘 단어라는 점입니다.

이 때문에 글을 써주는 LLM은 생성형 AI에 속하지만, 그렇다고 ‘생성형 AI = LLM’이라고 할 수는 없습니다. 실제로 미국 국립표준기술연구소(NIST)의 정의를 보더라도, 생성형 AI를 ‘데이터의 구조와 특징을 학습해 텍스트, 이미지, 오디오, 비디오 등 새로운 콘텐츠를 만들어내는 AI’로 폭넓게 정의하고 있습니다.

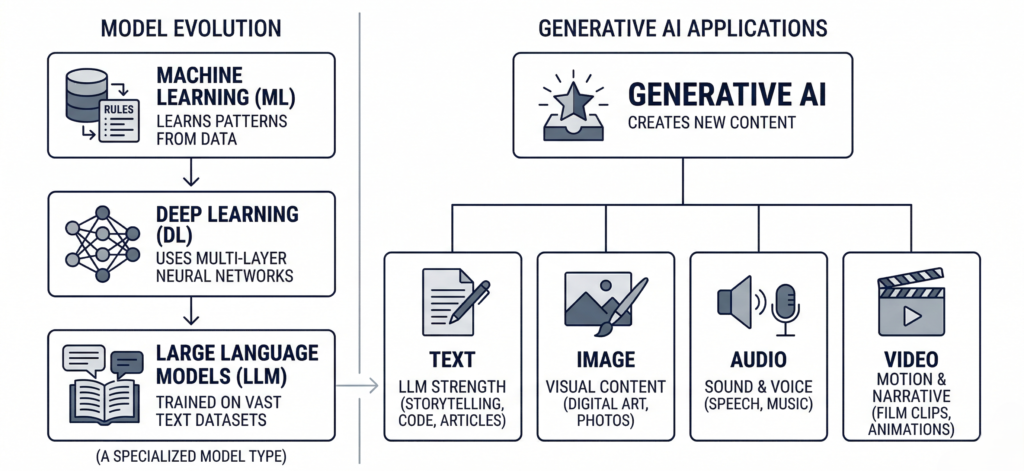

1. 머신러닝(기계학습): 데이터를 보고 규칙을 배우는 단계

기계학습(머신러닝)은 AI를 이해할 때 가장 먼저 짚고 넘어가야 할 핵심 개념입니다. 아주 쉽게 말해, 사람이 컴퓨터에게 일일이 규칙을 입력하는 대신 ‘수많은 데이터를 주고 스스로 패턴을 찾아내게’ 하는 방식입니다. 우리가 매일 쓰는 이메일 스팸 필터나 유튜브 추천 시스템, 기업의 수요 예측, 그리고 병원에서의 의료 영상 분류 등이 모두 이 기술을 바탕으로 움직입니다.

여기서 오해하지 말아야 할 점은, 기계가 한다는 ‘학습’이 사람처럼 의미를 깊이 이해한다는 뜻은 아니라는 겁니다. 철저히 데이터 속에 숨겨진 반복적인 패턴을 찾아내어, 새로운 입력이 들어왔을 때 더 정확하게 예측하거나 분류해 내는 과정에 가깝습니다.

기계학습은 데이터를 가르치는 방식에 따라 크게 세 가지로 나눌 수 있습니다.

- 지도학습: 정답지가 있는 데이터를 주며 가르치는 방식

- 비지도학습: 정답 없이 데이터만 주고 스스로 비슷한 것끼리 묶어보게 하는 방식

- 강화학습: 수많은 시행착오를 거치며 보상을 통해 최적의 행동을 개선해 나가는 방식

처음 AI를 접하신다면 이 한 줄만 기억하셔도 충분합니다.

💡 기계학습 = AI가 데이터를 통해 스스로 패턴을 깨우치는 가장 대표적인 방

2. 딥러닝: 복잡한 패턴을 더 잘 배우는 기계학습

딥러닝은 기계학습 안에 포함되는 하위 개념입니다. 즉, 기계학습과 아예 다른 별개의 기술이 아니라 기계학습을 구현하는 여러 방식 중 하나일 뿐입니다.

그렇다면 왜 이름에 깊다는 뜻의 ‘딥(Deep)’이 붙었을까요? 핵심은 데이터를 처리하는 ‘여러 겹의 층(Layer)’에 있습니다. AI 분야의 석학인 LeCun, Bengio, Hinton의 고전적 리뷰에 따르면, 딥러닝은 여러 처리 계층을 가진 모델이 데이터의 다층적 표현을 단계별로 학습하는 방식을 말합니다. 인간의 뇌 신경망을 모방한 이런 깊은 구조 덕분에, 딥러닝은 음성 및 시각 인식, 객체 탐지, 텍스트 처리 같은 고도의 복잡한 문제에서 혁신적인 성과를 낼 수 있었습니다.

하지만 딥러닝이 무조건적인 만능열쇠는 아닙니다. 뛰어난 성능만큼이나 훨씬 더 방대한 데이터와 막대한 컴퓨팅 자원이 필요합니다. 게다가 내부 판단 과정이 워낙 복잡하게 얽혀 있다 보니, AI가 왜 그런 결론을 내렸는지 명확하게 설명하기 어려운 이른바 ‘블랙박스(Black Box)’ 현상이라는 한계도 뒤따르기 쉽습니다.

이 관계를 정리하면 다음과 같습니다.

💡 기계학습이 “데이터로 배우는 전반적인 방법”이라면, 딥러닝은 그중에서도 “복잡한 패턴을 한층 더 정교하게 배우도록 진화한 강력한 방식”입니다.

3. LLM: 인간의 언어를 배우는 데 특화된 딥러닝

이제 많은 분에게 가장 친숙한 용어인 LLM으로 넘어갈 차례입니다. LLM은 대규모 언어 모델(Large Language Model)의 약자입니다. 아주 단순하게 표현하자면, ‘다음에 올 단어나 문장을 예측하는 능력’을 방대한 데이터와 파라미터(매개변수)를 통해 극대화한 언어 모델이라고 이해하시면 됩니다.

여기서 딥러닝과의 관계를 보여주는 중요한 두 가지 포인트가 있습니다.

- 첫째, LLM은 ‘언어에 특화된 딥러닝 모델’입니다. 현대의 LLM은 대체로 ‘트랜스포머(Transformer)’라는 신경망 구조를 기반으로 발전해 왔습니다. 구글 연구진이 발표한 기념비적인 논문 <Attention Is All You Need>에서 핵심 정보에 집중(Attention)하는 이 구조를 처음 제안했고, 이후 트랜스포머는 현대 언어 모델 발전의 뼈대가 되었습니다.

- 둘째, LLM의 본질은 ‘언어 패턴 예측’입니다. 챗봇과 대화하고, 글을 요약하고, 번역하고, 심지어 코딩까지 해내는 이 모든 화려한 기능의 출발점은 결국 ‘패턴 예측’입니다. 유명한 GPT-3 논문논문에서도 증명했듯, 모델의 규모를 키우면 수많은 예시를 주지 않더라도(Zero-shot, Few-shot) 언어와 관련된 다양한 복잡한 과제들을 훌륭하게 수행해 냅니다.

하지만 여기서 초보자분들이 반드시 기억해야 할 함정이 하나 있습니다. 바로 말의 유창함이 곧 사실을 의미하지는 않는다’는 점입니다.

LLM은 기존의 방대한 데이터를 바탕으로 확률적으로 가장 그럴듯한 다음 단어를 예측할 뿐입니다. 그렇기 때문에 문장은 아주 자연스럽지만, 실제로는 문맥을 잘못 이해했거나 완전히 지어낸 거짓 정보를 진실처럼 내뱉기도 합니다. 미국 국립표준기술연구소(NIST)의 생성형 AI 프로파일에서도 이런 현상을 ‘작화(Confabulation, 환각 현상)’의 위험으로 경고하고 있죠.

즉, 끊겨 있던 마지막 문장을 완성하며 이 관계를 정리하면 다음과 같습니다.

💡 LLM = 딥러닝 기술을 방대한 텍스트에 적용해 사람의 언어 패턴을 학습한 모델로, 유창하게 글을 만들어 내지만 그 내용이 항상 ‘진실’을 보장하는 것은 아닙니다.

4. 생성형 AI: 기술이 아닌 ‘결과물’로 묶어 부르는 이름

생성형 AI는 앞서 살펴본 세 가지 용어와 결이 조금 다릅니다. 기계학습, 딥러닝, LLM이 어떤 기술을 썼는지(기술의 계보)를 설명하는 말이라면, 생성형 AI는 그 기술로 무엇을 하는지(결과물의 성격)를 설명하는 말에 가깝습니다.

이름 그대로 세상에 없던 새로운 콘텐츠를 ‘생성’해 내는 것이 이 범주의 핵심입니다. 미국 국립표준기술연구소(NIST) 역시 생성형 AI를 “데이터의 구조와 특성을 학습해 텍스트, 이미지, 비디오, 오디오 등의 새로운 콘텐츠를 만들어내는 AI”로 폭넓게 정의하고 있습니다.

따라서 글을 써주는 챗봇도 생성형 AI고, 그림을 그려주는 모델도 생성형 AI입니다. 텍스트를 만들어 낼 때는 주로 LLM이라는 기술이 쓰이지만, 이미지나 영상, 음악을 만들어 낼 때는 LLM이 아닌 다른 딥러닝 기술들이 쓰이기도 하는 것이죠.

이 복잡해 보이는 관계를 한 번에 이해하기 위해, 머릿속에 한 장의 지도를 그린다면 이렇게 정리할 수 있습니다.

💡 AI 용어정리 핵심 요약

- 기계학습: 데이터를 보고 스스로 패턴을 배우는 방법

- 딥러닝: 그중에서도 복잡한 패턴을 깊게 학습하는 강력한 방법

- LLM: 딥러닝 중에서도 ‘사람의 언어’를 다루는 데 특화된 모델

- 생성형 AI: 글, 그림, 음악 등 새로운 결과물을 만들어내는 AI 서비스의 총칭

이 지도를 이해하셨다면, 뉴스를 읽을 때 헷갈리지 않는 중요한 결론을 얻을 수 있습니다.

모든 LLM은 AI에 속하지만, 모든 AI가 LLM인 것은 아닙니다. 마찬가지로 텍스트를 만드는 LLM은 생성형 AI의 일부일 뿐입니다. 생성형 AI는 이미지와 오디오 생성 모델까지 모두 포함하는 훨씬 더 넓은 범주입니다.

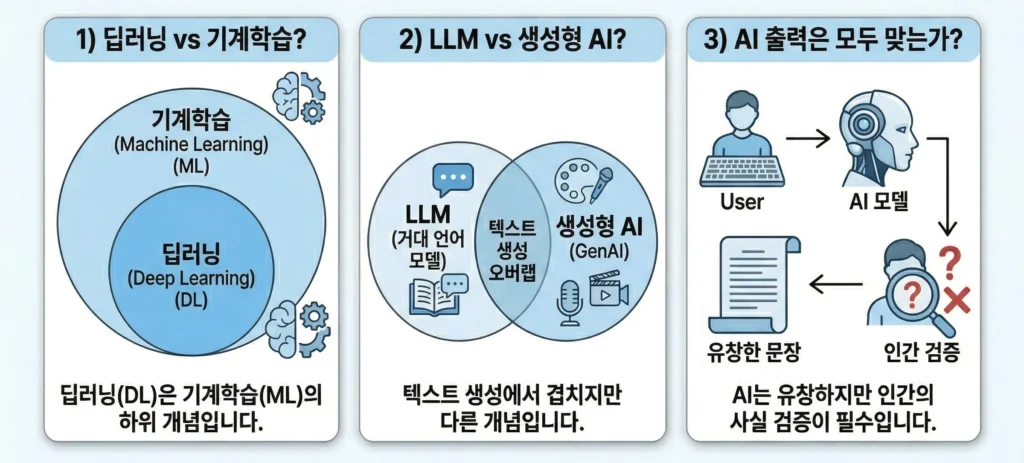

5. AI를 처음 접할 때 가장 헷갈리는 세 가지 질문

1) 딥러닝과 기계학습은 같은 말인가요?

아닙니다. 딥러닝은 기계학습에 포함되는 하위 개념입니다. 즉, 모든 딥러닝은 기계학습이지만 모든 기계학습이 딥러닝인 것은 아닙니다.

2) LLM과 생성형 AI는 같은 말인가요?

같지 않습니다. LLM은 ‘언어’에 특화된 모델이고, 생성형 AI는 새로운 콘텐츠를 만들어내는 AI ‘전체’를 뜻합니다. 텍스트를 만들 때는 두 개념이 겹치지만, 이미지나 오디오 생성까지 고려하면 생성형 AI가 훨씬 더 넓은 범주입니다.

3) AI의 답변은 모두 맞는것 아닌가요?

꼭 그렇지는 않습니다. AI의 유창한 문장은 확률적으로 가장 그럴듯한 단어들을 이어서 출력한 결과일 뿐입니다. LLM은 초안 작성, 요약, 아이디어 확장에는 뛰어나지만, 사실 검증과 최종적인 책임 판단은 반드시 사람이 직접 해야 합니다.

마치며: 딱 한 문장만 기억한다면

이 글을 다 읽고 단 하나만 남겨야 한다면, 다음 문장만 기억해 주세요.

“AI라는 가장 큰 테두리 안에 데이터를 보고 배우는 ‘기계학습’이 있고, 그중 복잡한 패턴에 강한 방식이 ‘딥러닝’이며, 언어에 특화된 딥러닝 모델이 ‘LLM’이다. 그리고 이런 모델들을 활용해 새로운 결과물을 만들어내는 범주를 ‘생성형 AI’라고 부른다.”

이 AI 용어정리 뼈대만 잡아두어도, 뉴스에서 말하는 “AI”가 추천 시스템인지, 챗봇인지, 이미지 생성 도구인지 훨씬 쉽게 구분할 수 있습니다. 그리고 그 구분이 바로 AI 문해력(리터러시)의 출발점입니다.

다음 글에서는 실전으로 한 걸음 더 들어가, AI를 본격적으로 활용하기 전에 반드시 갖춰야 할 질문법, 사실 검증, 책임, 그리고 도구 선택의 감각에 대해 알아보겠습니다.

FAQ (자주 묻는 질문)

Q. 기계학습과 딥러닝 중 무엇을 먼저 이해해야 하나요?

상위 개념인 기계학습을 먼저 이해하는 것이 좋습니다. 딥러닝은 기계학습에 속한 하위 기술이기 때문에, 큰 틀을 먼저 잡아두어야 세부 개념을 배울 때 헷갈리지 않습니다.

Q. LLM은 왜 갑자기 이렇게 중요해졌나요?

컴퓨터가 인간의 언어를 다루는 능력이 비약적으로 발전했기 때문입니다. ‘트랜스포머’ 구조와 대규모 데이터 학습 덕분에 성능이 크게 뛰었고, 예시를 일일이 주지 않아도(Zero-shot, Few-shot) 다양한 지시를 훌륭하게 수행할 수 있게 되었습니다.

Q. 생성형 AI는 모두 챗봇인가요?

아닙니다. 챗봇은 텍스트를 만들어내는 대표적인 사례일 뿐입니다. 생성형 AI는 글을 넘어 이미지, 오디오, 비디오 등 세상에 없던 새로운 콘텐츠를 만들어내는 훨씬 더 넓은 범주를 뜻합니다.

Q. LLM이 그럴듯하게 말하면 사실이라고 믿어도 되나요?

그렇게 믿으면 안 됩니다. LLM은 방대한 데이터를 바탕으로 다음에 올 단어를 확률적으로 예측할 뿐, 스스로 참과 거짓을 판단하지는 못합니다. 그럴듯한 거짓말을 만들어낼 수 있으므로, 문장의 ‘유창함’과 정보의 ‘사실성’은 반드시 구분해서 검증해야 합니다.

참고 자료

- 김용성, 『AI 리터러시: 인공지능 필수 지식부터 완벽 활용까지』

- LeCun, Y., Bengio, Y., & Hinton, G. (2015). “Deep learning.” Nature.

- Vaswani, A. et al. (2017). “Attention Is All You Need.”

- Brown, T. B. et al. (2020). “Language Models are Few-Shot Learners.”

- NIST. (2024). Artificial Intelligence Risk Management Framework: Generative Artificial Intelligence Profile.

함께 읽으면 좋은 글: AI 시대의 기본 문해력: AI리터러시

다음 글 예고: AI를 배우기 전에 먼저 익혀야 할 질문 습관, 검증 습관, 개인정보와 저작권 감각을 정리합니다.